深度学习深度信念网络DeepBeliefNetwork

深度学习深度信念网络DeepBeliefNetwork

《深度学习深度信念网络DeepBeliefNetwork》由会员分享,可在线阅读,更多相关《深度学习深度信念网络DeepBeliefNetwork(9页珍藏版)》请在装配图网上搜索。

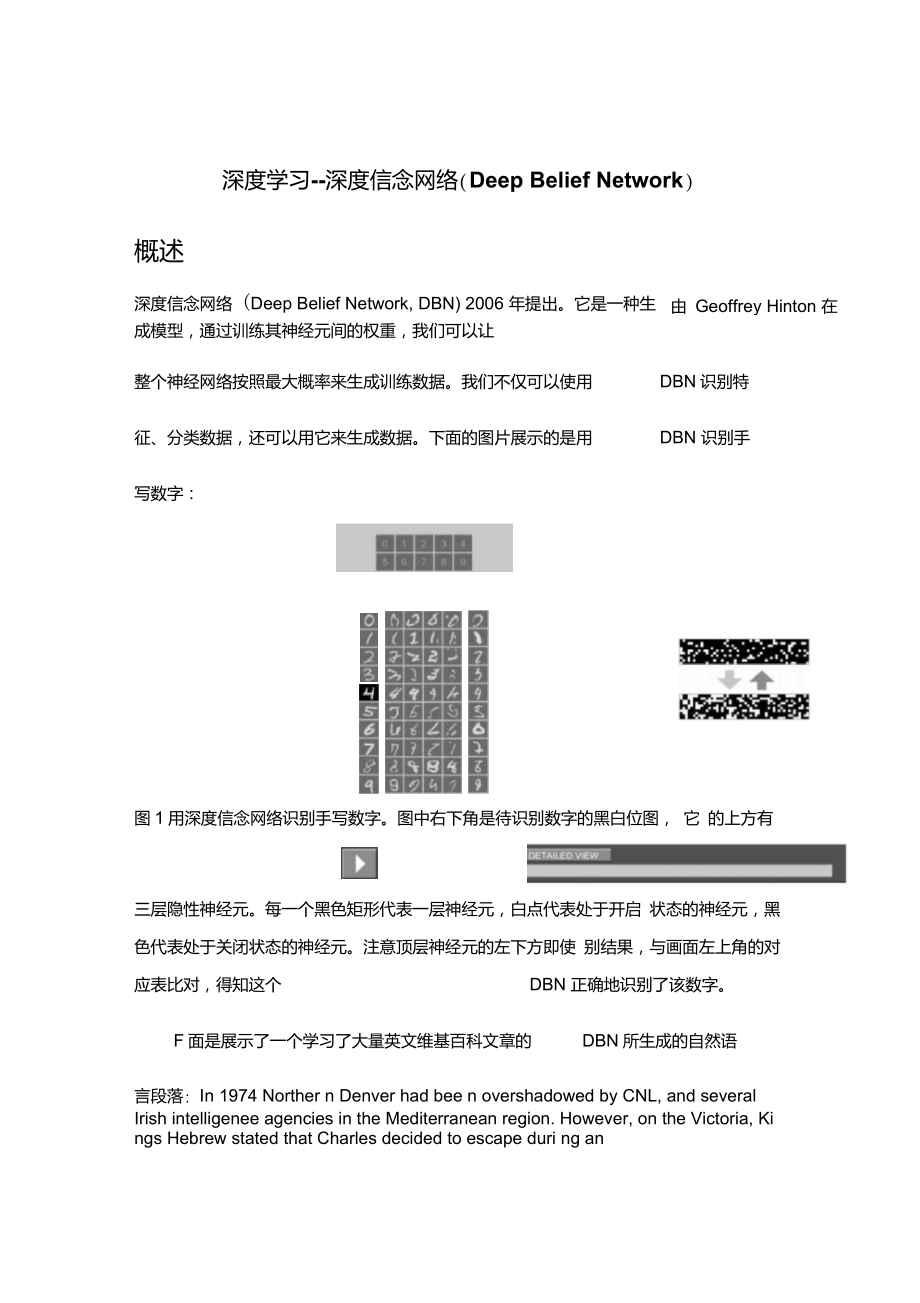

1、1深度学习-深度信念网络(Deep Belief Network)概述由 Geoffrey Hinton 在深度信念网络 (Deep Belief Network, DBN) 2006 年提出。它是一种生成模型,通过训练其神经元间的权重,我们可以让整个神经网络按照最大概率来生成训练数据。我们不仅可以使用DBN识别特征、分类数据,还可以用它来生成数据。下面的图片展示的是用DBN 识别手写数字:图1用深度信念网络识别手写数字。图中右下角是待识别数字的黑白位图, 它 的上方有三层隐性神经元。每一个黑色矩形代表一层神经元,白点代表处于开启 状态的神经元,黑色代表处于关闭状态的神经元。注意顶层神经元的左

2、下方即使 别结果,与画面左上角的对应表比对,得知这个DBN 正确地识别了该数字。F面是展示了一个学习了大量英文维基百科文章的DBN所生成的自然语言段落: In 1974 Norther n Denver had bee n overshadowed by CNL, and several Irish intelligenee agencies in the Mediterranean region. However, on the Victoria, Ki ngs Hebrew stated that Charles decided to escape duri ng anallianee.

3、The mansion house was completed in 1882, the second in its bridge are omitted, while closing is the proton reticulum composed below it aims, such that it is the blurring of appearing on any well-paid type of box prin ter.DBN 由多层神经元构成,这些神经元又分为 显性神经元 和隐性神经元(以 下简称显元和隐元)。显元用于接受输入,隐元用于提取特征。因此隐元也有个 别名,叫特征

4、检测器(feature detectors)。最顶上的两层间的连接是无向的,组成联合内存(associative memory)。较低的其他层之间有连接上下的有向连接。最底层代表了数据向量(data vectors),每一个神经元代表数据向量的 一维。DBN 的组成元件是受限玻尔兹曼机(Restricted BoltzmannMachines, RBM)。训练 DBN 的过程是一层一层地进行的。在每一层中,用 数据向量来推断隐层,再把这一隐层当作下一层(高一层)的数据向量。受限玻尔兹曼机如前所述,RBM是DBN的组成元件。事实上,每一个 RBM都可以单独用作聚类器RBM 只有两层神经元,一层叫

5、做 显层(visible layer),由显元(visibleunits)组成,用于输入训练数据。另一层叫做隐层(Hidden layer),相应地,由隐元(hidden units)组成,用作特征检测器(feature detectors) 。hhldeii unitsvisible units图2受限玻尔兹曼机的结构。图中的较上一层神经元组成隐层, 较下的神经元 组成显元。每一层都可以用一个向量来表示, 每一维表示每个神经元。注意这两层间的对称(双向)连接神经元之间的条件独立性应注意到,显层和隐层内部的神经元都没有互连, 只有层间的神经元有对称的连 接线。这样的好处是,在给定所有显元的值的

6、情况下,每一个隐元取什么值是互 不相关的。也就是说,P(h | v) =| v)同样,在给定隐层时,所有显元的取值也互不相关:P(v |h)=匸二 F(u| h)有了这个重要性质,我们在计算每个神经元的取值情况时就不必每次计算一个, 而是同时并行地计算整层神经元。使用RBM的过程假设我们现在已经得到一个训练好的RBM,每个隐元与显元间的权重用矩阵4#W表示,且:i,iWl,2其中Wij代表从第i个显元到第j个隐元的权重,M代表显元的个数,N代表隐元的个数。那么,当我们把一条新来的数据 X ,J 附给(clamp to)显层后,RBM 将会依照权值 W来决定开启或关闭隐元。具体的操作如下:首先,

7、将每个隐元的激励值(activatio n) 计算出来:h = Wx注意,这里用到了前面提到的神经元之间的条件独立性。然后,将每个隐元的激励值都用S形函数进行标准化,变成它们处于开启#状(用1表示)的概率值:=1)=H%) =1 + e#此处的S形函数我们采用的是Logistic 函数:#a -1+至此,每个隐元hj开启的概率被计算出来了。其处于关闭状态(用0表示)的概率自然也就是P(hj =0) = 1 P(曾=1)那么到底这个元开启还是关闭,我们需要将开启的概率与一个从0,1 均匀分 布中抽取的随机值u t/(0; 1)进行如下比较_ Pg = 1) )=|0, P(h. = l)u然后开

8、启或关闭相应的隐元。给定隐层,计算显层的方法是一样的。训练RBMRBM的训练过程,实际上是求出一个最能产生训练样本的概率分布。也就是说, 要求一个分布,在这个分布里,训练样本的概率最大。由于这个分布的决定性因 素在于权值W,所以我们训练 RBM 的目标就是寻找最佳的权值。为了保持 读者的兴趣,这里我们不给出最大化对数似然函数的推导过程,直接说明如何训练 RBM。G. Hi nto n 提出了名为对比散度 (Co ntrastive Diverge nee) 的学习算法F面我们来详述它的具体过程我们沿用前文的符号记法。算法1.对比散度对于训练集中的每一条记录算法h对比散度对于训练集中的每条记眾X

9、有:将葢附给显层迪.计算它便隐神经元被开启的概率 p溟: =1 |严)=巩W严)式巾啲上标用于区别不同向止 下标用干区别同向曲t啲不同维。 然后*从计算山的概率分布抽取一个样本hW P(的 | 评)用h他重构足层P(咱二 1 I h)=CT(W7 hi0)同样*抽取出显层的-彳样上理(严|們再次用显层神经元巫构之S的)计鱒岀隐层神经元被开启的慨率 P(h;H = 1 | V)=(7(W 2)按下式刪HE:W W 十人(F(h朋=11 严)严丁 - Pfh(1) = 11 v1)v(,T如此训练之后的RBM就能较为准确地提取显层的特征,或者根据隐层所代表 的特征还原显层了。深度信念网络前文我们已

10、经介绍了 RBM 的基本结构和其训练、使用过程,接下来我们介绍DBN 的相关内容。DBN 是由多层 RBM 组成的一个神经网络,它既可以被看作一个生成模型, 也可以当作判别模型,其训练过程是:使用非监督贪婪逐层方法去预训练获得权 值。训练过程:1. 首先充分训练第一个 RBM ;2. 固定第一个 RBM 的权重和偏移量,然后使用其隐性神经元的状态,作为 第二个RBM的输入向量;3. 充分训练第二个 RBM后,将第二个 RBM堆叠在第一个RBM的上 方;4. 重复以上三个步骤任意多次;5. 如果训练集中的数据有标签,那么在顶层的 RBM 训练时,这个RBM 的 显层中除了显性神经元,还需要有代表

11、分类标签的神经元,一起进行训练:a)假设顶层RBM的显层有500 个显性神经元,训练数据的分类一共分成了 10 类;b)那么顶层 RBM 的显层有510 个显性神经元,对每一训练训练数据,相 应的标签神经元被打开设为 1,而其他的则被关闭设为 0。6. DBN 被训练好后如下图:(示意)图3训练好的深度信念网络。图中的绿色部分就是在最顶层 RBM 中参与训练的标签。注意调优 (FINE-TUNING)过程是一个判别模型另:P(hjv)hOO oo oo voo6 006 *000DataReconstructed P(vjh)调优过程(Fine-Tuning) :生成模型使用 Con tras

12、tive Wake-Sleep 算法进行调优,其算法过程是:1. 除了顶层 RBM,其他层 RBM 的权重被分成向上的认知权重和向下的生 成权重;2. Wake 阶段:认知过程,通过外界的特征和向上的权重 (认知权重)产生每 一层的抽象表示(结点状态),并且使用梯度下降修改层间的下行权重 (生成权 重)。也就是如果现实跟我想象的不一样,改变我的权重使得我想象的东西就是这样的”。3. Sleep 阶段:生成过程,通过顶层表示 (醒时学得的概念)和向下权重,生 成底层的状态,同时修改层间向上的权重。也就是 如果梦中的景象不是我脑中 的相应概念,改变我的认知权重使得这种景象在我看来就是这个概念”念、0使用过程:1. 使用随机隐性神经元状态值,在顶层 RBM 中进行足够多次的吉布斯抽 样;2. 向下传播,得到每层的状态。9

- 温馨提示:

1: 本站所有资源如无特殊说明,都需要本地电脑安装OFFICE2007和PDF阅读器。图纸软件为CAD,CAXA,PROE,UG,SolidWorks等.压缩文件请下载最新的WinRAR软件解压。

2: 本站的文档不包含任何第三方提供的附件图纸等,如果需要附件,请联系上传者。文件的所有权益归上传用户所有。

3.本站RAR压缩包中若带图纸,网页内容里面会有图纸预览,若没有图纸预览就没有图纸。

4. 未经权益所有人同意不得将文件中的内容挪作商业或盈利用途。

5. 装配图网仅提供信息存储空间,仅对用户上传内容的表现方式做保护处理,对用户上传分享的文档内容本身不做任何修改或编辑,并不能对任何下载内容负责。

6. 下载文件中如有侵权或不适当内容,请与我们联系,我们立即纠正。

7. 本站不保证下载资源的准确性、安全性和完整性, 同时也不承担用户因使用这些下载资源对自己和他人造成任何形式的伤害或损失。